À l’occasion de la tournée anniversaire de Moon Safari, le groupe AIR nous a ouvert les coulisses. Quelques heures avant leur concert parisien, nous avons rencontré deux figures clés de l’équipe technique : Julien Vouillon et Florentin Convert. Spécialistes du mixage in-ear et de l’architecture immersive, ils nous ont généreusement accordé deux heures pour dérouler avec précision leur approche du live, le choix des microphones DPA, et les principes qui sous-tendent leur quête DU son. Pendant cet échange, nous avons traversé avec eux chaque étape de leur réflexion, observé les ajustements, suivi le cheminement et compris comment cette configuration sonore a pu voir le jour sur cette tournée. C'est certain, cette plongée au cœur du son de AIR méritait d’être partagée.

Présentation

Bonjour à vous deux et merci de nous recevoir. Est-ce que vous voulez vous présenter en quelques mots et nous dire comment le son est arrivé dans votre vie ?

Julien : Bonjour et merci pour l’accueil ! En quelques mots, je suis ingénieur du son, spécialisé dans le mixage in-ear, principalement en live, avec également quelques projets en télévision musicale. Depuis toujours, j’ai été attiré par l’univers du concert, et c’est une rencontre décisive qui m’a fait basculer dans le milieu du son. J’ai débuté directement aux retours, sans passer par la façade. Mon premier mix retour, en wedge, c’était pour Lee Scratch Perry — un moment évidemment marquant pour moi. Lorsque les systèmes in-ear sont apparus, j’ai été appelé pour la tournée Tourist de Saint-Germain, au tout début de la French Touch. Depuis 2000, je me consacre entièrement au mix in-ear, avec une approche de plus en plus proche du son studio, c'est-à dire un son très produit.

Florentin : Bonjour, moi c’est Florentin Convert. Je suis aussi ingénieur du son. J'ai commencé par faire de la musique, je jouais de la batterie. Et lors d’un concert où je jouais en première partie, j’ai croisé Julien, qui était en tournée avec Johnny Hallyday. J’avais 18 ans à l’époque. On a discuté longuement, et même si j'hésitais encore, cette rencontre a compté. Ensuite, chacun a suivi son chemin, jusqu’à ce qu’on se recroise dix ans plus tard. J'ai toujours été passionné par la physique et la technique. Le métier d’ingénieur du son s’est imposé comme un parfait équilibre entre l’artistique et la technique. J’ai fait des études à l'INA, travaillé pour des prestataires, notamment dans la gestion des HF. Je faisais le son de projets très indépendants principalement en Europe, puis j’ai été appelé pour faire des retours sur des tournées de plus grande envergure.

La collaboration

Florentin : Peu de temps après que je me sois lancé, nous nous sommes retrouvés avec Julien sur la tournée de Lomepal. On a tout de suite très bien bossé ensemble, la collaboration a été naturelle. Nous sommes très complémentaires.

Julien : On a vraiment la même oreille : on entend exactement les mêmes choses. Avec plusieurs décennies d'expérience derrière moi, je peux dire que c'est assez rare (rire). C’est même la première fois que je rencontre quelqu'un qui perçoit le son exactement comme moi. Nous sommes très complémentaires, car nous avançons dans la même direction, avec des compétences différentes mais qui se complètent parfaitement. Cela profite directement à l’artiste : on a deux manières d'atteindre le même objectif, ce qui nous rend beaucoup plus efficaces. On sait précisément ce qu'on veut obtenir, même si parfois l'un ou l'autre doit trouver la solution technique. Selon le domaine, cette complémentarité fait toute la différence.

Florentin : En travaillant ensemble, on est allés beaucoup plus loin que si chacun avait travaillé de son côté. Tout va plus vite, surtout dans la recherche d'améliorations. On essaie toujours d’apporter de la nouveauté dans ce qu’on fait, parce que ce métier peut parfois devenir un peu rébarbatif si on ne se renouvelle pas constamment.

La vision du marché

Julien : Les évolutions technologiques sont impressionnantes. Les in-ears sont arrivés à la fin des années 90, début 2000, et déjà à l’époque, on voyait se profiler la possibilité de produire un son live de plus en plus fidèle à celui d’un album.

Aujourd'hui, c’est devenu une exigence. Sur les trois ou quatre derniers projets sur lesquels nous avons travaillé, le premier élément inscrit dans le cahier des charges, c'était la reproduction exacte du son de l'album : en façade, en retour, et avec un rendu aussi proche que possible de celui du disque. Aujourd’hui, la manière même de produire la musique a profondément changé. Grâce à l’informatique, de plus en plus de producteurs travaillent directement depuis chez eux. Dans leur chambre, des artistes façonnent des morceaux qui rencontrent parfois un succès immense, sans forcément être passés par la scène. Ils ont passé des heures, des semaines à peaufiner chaque détail de leur disque, à modeler non seulement les sons d’instruments, mais aussi des textures, des effets précis, qui font partie intégrante de leur identité. Quand ils montent sur scène, ils veulent retrouver ce même confort, ce même univers sonore que celui qu’ils ont construit en studio.

C’est là que notre rôle prend tout son sens : leur offrir une véritable continuité entre le studio et la scène. faire en sorte que le son, aussi bien en façade qu’en retour, soit fidèle à l’album. Le public doit ressentir la même émotion, reconnaître instantanément l’artiste, son univers, ses morceaux, son identité sonore. Le marché est organisé ainsi désormais, et c'est devenu la norme.

Florentin Convert et Julien Vouillon

Si je regarde ces quatre dernières années, les groupes actuels, très exigeants sur leur production, passent des mois, voire des années, à peaufiner leur son. Quand ils partent en tournée, ils veulent retrouver exactement le même rendu que sur l’album, aussi bien en façade qu’en retour.

Je me souviens d'un groupe qui, après une première tentative ratée avec une équipe technique qui n’était pas en capacité de reproduire le son, a décidé d'organiser un casting d’ingénieurs du son. Ils ont envoyé trois titres en version brute à plusieurs équipes, en leur demandant de reproduire le plus fidèlement possible ce qu’ils avaient créé en studio — sans aucune indication technique.

Ils cherchaient quelqu’un capable d’atteindre ce résultat, sans pouvoir deviner comment la production avait été réalisée. Ils voulaient aussi que les sons soient automatisés en live. J'ai participé à ce casting. Ils avaient déjà sélectionné les ingénieurs façade et système, et cherchaient quelqu'un pour les retours. Mon rôle a été d’adapter leur travail pour le mixage in-ear, afin que le son soit parfaitement identique à celui de la façade et du disque. Depuis, le marché plus globalement s'est structuré autour de cette exigence. Cette approche m'a ensuite amené à travailler sur la tournée de Lomepal, où Florentin était déjà en poste, avec une démarche similaire : reproduire le son de l’album sur scène. La contrainte supplémentaire, cette fois, était de le faire sans ordinateur : pas de séquence, pas d'Ableton. Les musiciens — qui étaient aussi les producteurs du disque — voulaient tout jouer en direct, en retrouvant le son exact du disque, sans être aidés par un ordinateur. C’est cette expertise qui nous a amenés aujourd'hui à travailler sur la tournée événement d’AIR, pour les 25 ans de Moon Safary.

La tournée de AIR

La préparation du live

Julien : Le mix des in-ear monitors — comme celui de la façade — est très produit, proche de l’album, avec quelques ajustements d’équilibre bien sûr. Cela reste un mix de retour : certains éléments doivent ressortir davantage pour que les musiciens puissent jouer avec précision. Mais nous veillons à respecter les timbres et les textures sonores à 100 %. Pour atteindre un niveau de production qui nous semblait satisfaisant, nous avons dû travailler de manière rigoureuse et méthodique.

Claviers

Pour les claviers et synthés — très présents dans la musique de AIR —, nous avons fait un travail de sélection des DI. En studio, nous avons testé toutes (ou presque!) les DI du marché sur chaque instrument. C'était la première fois qu'on poussait aussi loin ce type de tests. Ce travail était vraiment passionnant.

Florentin : Ça nous a permis de découvrir que certaines habitudes qu’on pensait ok ne l'étaient pas tant que ça, et inversement. Ce travail d’A/B testing nous a permis de trouver les meilleures combinaisons.

Julien : En amont, nous avions passé plusieurs nuits en préprod chez MPM, à réécouter le disque original, à récupérer les multipistes bruts des répétitions, à retrouver les effets et leur timing précis. Nous avions préparé des bus d'effets par poste, par type d'instrument, pour reproduire le disque à partir des multipistes. Le but était simple : que le jour de leur arrivée, ils mettent leurs ears... et retrouvent directement le son de l'album.

Quand les artistes sont arrivés en studio, ils ne nous connaissaient pas encore. Dans un grand studio de 100 m², nous avions simplement la console face à eux. Ils ont mis leurs ears... et ils ont commencé à jouer, ils devaient se sentir à l'aise immédiatement et ça a fonctionné !

Le travail sur la batterie

Les Toms

DPA 2012

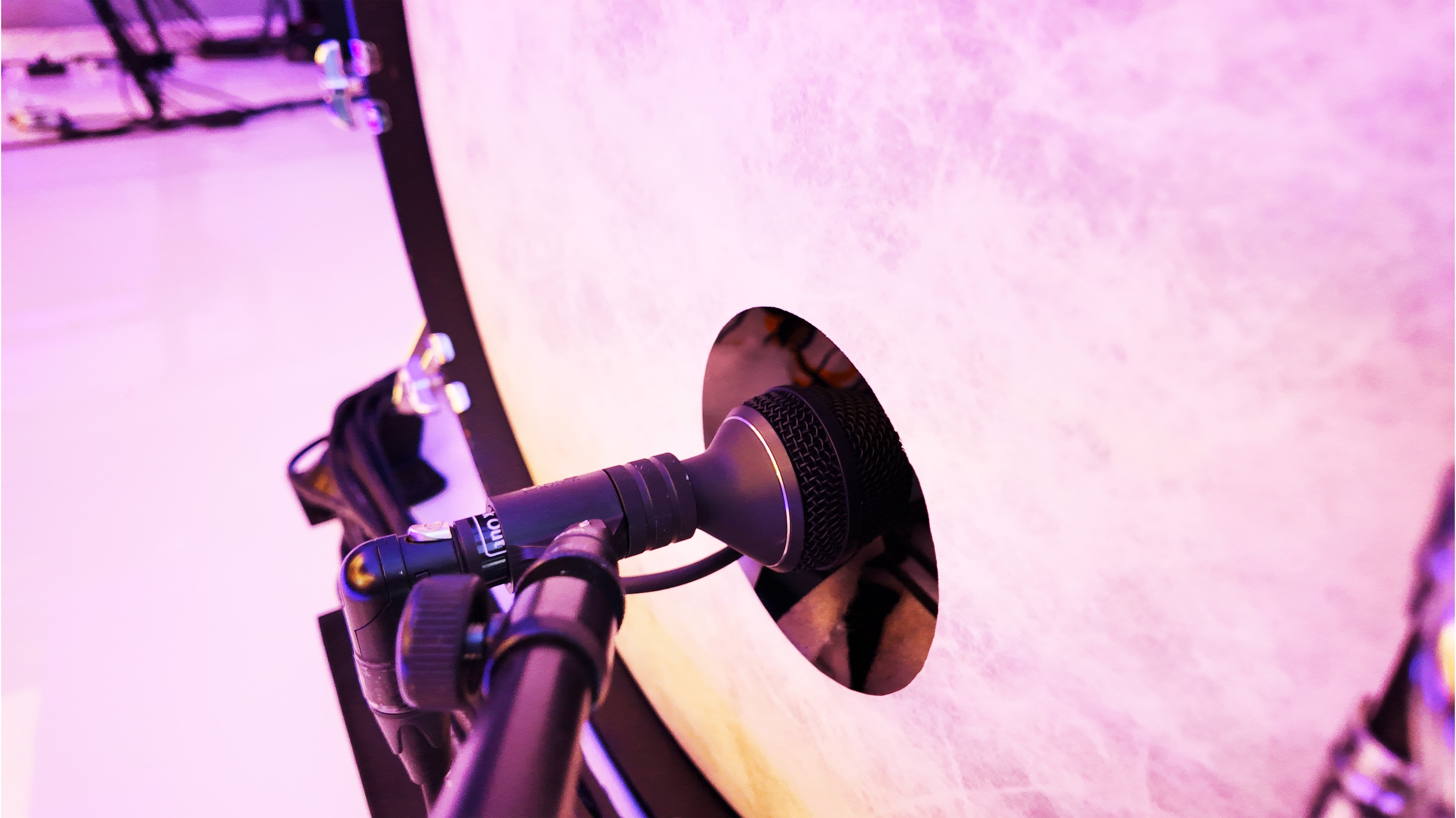

Florentin : On a passé beaucoup de temps à travailler avec les backliners pour trouver les meilleures associations micro-instrument, notamment pour les sources acoustiques comme la batterie. Ils ont fait le choix d'avoir un batteur sur scène, ce qui n’était pas systématiquement le cas sur l'album original. Il s'agissait donc de recréer une ambiance de batterie qui colle au son de Moon Safari. Et le résultat est vraiment super, la batterie sonne incroyablement bien, et Louis Delorme, le batteur, joue vraiment super. Il a ce côté très jazz des batteurs des années 70-80, qui correspond parfaitement au style d’AIR. Pour aller dans ce sens, nous avons utilisé des DPA 2012 et 4055 pour tout ce qui concerne les toms et les éléments rapprochés, à l'exception de la caisse claire et des overheads.

Louis n'avait jamais joué avec ces micros. On lui avait expliqué que s’il aimait le son naturel de sa batterie, il allait adorer le rendu. Dès qu’il a mis les ears et commencé à jouer, il a été bluffé : il nous a dit : « c’est la première fois que j’entends le son de mes toms exactement comme ils sonnaient sans micro ».

'Il a complètement oublié la prise de son, il a été bluffé par la sensation !'

DPA 4055

Pour conserver une petite touche vintage, nous avons tout de même utilisé des micros à ruban pour les overheads. Il y avait une double raison à cela : la volonté esthétique sonore, bien sûr, Mais aussi une contrainte technique, car la scénographie place les musiciens sous un toit en métal très réfléchissant. Les micros à ruban permettaient d’atténuer cet effet tout en respectant le caractère sonore recherché.

La grosse caisse

Julien : Nous avons utilisé le DPA 4055, que j’avais découvert quelques semaines auparavant lors d'une précédente tournée. Je l'avais trouvé très naturel. À ce moment-là, je ne connaissais pas encore les modèles 2012, 2015 et 2017. C’est Florentin qui m’a conseillé de les essayer, justement parce qu’ils sont très naturels et parfaitement alignés à nos exigences. Et effectivement, cela a hyper bien fonctionné. Après avoir goûté à ce genre de rendu, il est très difficile de revenir en arrière (Rire)

DPA 4055

Florentin : Lorsqu'on écoute un DPA 4055 sur une grosse caisse, on entend réellement le son de l’instrument, sans typage ni exagération. Chaque micro a ses avantages et ses limites, mais pour un batteur comme moi, ça fait toute la différence. C’est comparable à un guitariste avec une très belle guitare : il voudra qu’elle soit amplifiée par un ampli haut de gamme et qu’on retrouve ce son en dans les ears monitor.

Avec la batterie, c’est pareil. Lorsqu’un instrument est bien réglé et bien joué, l’utilisation de micros DPA sublime le son de l’instrument. Contrairement à d’autres références de micros (qui fonctionnent bien malgré tout), qui captent surtout la proximité et pas vraiment l’acoustique de l’instrument, toute la gamme DPA — 2012, 2015, 2017 et 4055 — procure la sensation d'une prise studio réalisée à deux ou trois mètres de distance, tout en restant en proximité. On récupère de l’air, de l’espace naturel autour du son, et cela ajoute une dimension très humaine, de la vie.

Julien : En live, nous sommes techniquement obligés de réaliser des prises de proximité à cause des contraintes du concert, mais grâce aux DPA, le rendu possède une dimension studio naturelle, sans avoir besoin de compenser avec des corrections lourdes. Je ne connais pas d’autres marques ou micros qui permettent d’obtenir un tel résultat. C'était souvent frustrant pour les musiciens et les techniciens d'être limités à des prises ultra-proches, qui manquaient d'air et de vie. On corrige moins et le résultat se rapproche vraiment de ce que l'on imagine.

La scénographie

Est-ce que la scénographie a complexifié votre travail ?

Julien : Oui, clairement. Les musiciens sont enfermés dans une sorte de boîte avec des murs parfaitement parallèles, ce qui est typiquement ce qu’il ne faut pas faire en acoustique (rire). Comme pour les choix de DI et de micros, nous avons travaillé pour isoler au maximum les sources et obtenir le son le plus naturel possible. Il a fallu réussir à minimiser l'impact acoustique de la pièce, qui au départ ne jouait vraiment pas en notre faveur. Il y avait une contrainte scénographique énorme. Dès les premiers moodboards et rendus que nous avons reçus, nous avons vu que, visuellement, c'était magnifique. Mais d’un point de vue sonore, on savait que ce serait un cauchemar à gérer. (Rire)

Scénographie AIR

On a donc travaillé le placement et le choix des micros pour gommer autant que possible le son de la pièce autour de la batterie. Ce qui est amusant, c’est qu’on s’attendait à ce que ce soit un problème majeur... et en réalité, ça s’est révélé être un énorme avantage. Grâce à cette "boîte", on obtient exactement le même son de batterie chaque jour, quelle que soit la salle : Théâtre, festival, plein air... Peu importe l’environnement, le son de batterie reste constant. C’est un énorme confort en live. On a appris à jouer avec cette contrainte : On a conservé la couleur sonore qui nous intéressait et nous avons réussi à gommer celle qui posait problème.

Scénographie AIR

Esthétiquement, en plus, le résultat est magnifique. Quand on voit le show, on a vraiment l'impression d'entrer dans leur chambre. Tout l’imaginaire que l’on associe au travail de studio d’AIR est transporté sur scène. D'une certaine manière, c’est comme si leur studio voyageait avec eux.

Pourquoi DPA ?

Julien : En live, on est techniquement obligé de faire une prise de proximité — parce que c’est du live, avec toutes ses contraintes — mais le rendu a une dimension studio, naturelle, sans devoir compenser ensuite avec des corrections lourdes. Je ne connais pas d’autres marques ou micros qui permettent d’obtenir ce rendu. C'était souvent frustrant pour les musiciens et les techniciens d'être contraints à des prises ultra-proches qui manquaient d'air, de vie. En plus de par leur fidélité, on a beaucoup moins de choses à corriger derrière. On bosse moins, en fait ! (rire)

'Le résultat se rapproche vraiment d’une prise studio mais en live.'

Les automations

Julien Vouillon

Julien : Il fallait aussi trouver un équilibre : respecter le son d'origine — celui de Moon Safari, enregistré maison sur un simple 8 pistes —, tout en utilisant des outils modernes pour pouvoir enchaîner les titres et les multiples changements de sections (couplets, refrains, ponts, etc.).

Les musiciens sont seulement trois sur scène pour tout reproduire. Pour tenir ce défi en live, il faut des outils modernes tout en respectant l'âme sonore de l'époque. C'est ce que nous leur avons apporté.

Nous avons un setup Ableton dédié uniquement aux automatisations, géré par Lucas et Émile. Émile, qui nous a aussi beaucoup aidés sur d'autres aspects techniques, a été déterminant sur toute la partie MIDI. Sur scène, l’installation est volontairement sobre : les musiciens n’utilisent que quelques claviers visibles, mais pilotent en réalité de nombreux instruments en coulisses.

Tout est connecté à un rack contenant plusieurs claviers physiques — notamment des vocodeurs — qui sont commandés à distance depuis la scène. Il n'y a aucun plugin : nous utilisons uniquement du matériel réel pour conserver l’authenticité sonore. Le rôle d’Ableton ici est de piloter la console retour. Comme il n'était pas question d’utiliser des séquences pour rester fidèle à l’esprit live, Émile a développé un outil qui envoie en temps réel les Program Change nécessaires. Chaque changement de partie d’un morceau (couplet, refrain, pont) entraîne automatiquement le bon réglage sur les claviers, les pédaliers guitare et la console. Cela permet aux musiciens de se concentrer uniquement sur leur jeu, sans avoir à manipuler leurs instruments en cours de morceau. Et pour alléger la scénographie, seuls les claviers essentiels sont présents sur scène : tous les autres sont off-stage, mais restent actifs pour garantir le son original de l'album.

Une autre particularité concerne l’utilisation des vocodeurs, très présents dans Moon Safari. Traditionnellement, les musiciens utilisaient deux micros différents — un pour la voix naturelle, un pour la voix vocodée —, ce qui nécessitait quatre micros au total pour deux chanteurs, avec un rendu visuel assez lourd.

Florentin : Avec notre système, nous avons automatisé la gestion des micros directement via la console retour : Ableton envoie les instructions MIDI, qui déclenchent automatiquement l'ouverture ou la fermeture. Résultat : la voix naturelle est automatiquement coupée lorsqu'on passe en mode vocoder, et la voix traitée est envoyée proprement, après avoir été préparée pour optimiser le son du vocodeur. Cela permet de garder une esthétique de scène épurée et un résultat cohérent et propre aussi bien pour les retours que pour la façade.

Le vocoder VS la caisse claire :

Julien : Le principal problème venait du fait que, souvent, la caisse claire passait dans les micros du vocodeur. Résultat : on avait des sons parasites, des sortes de "ouiing" étranges. C'était vraiment complexe à gérer. Ça a été un « grand » truc (rire). Lorsque l'on ouvrait les tranches du vocoder pour capter la voix, tout ce qui passait devant le micro, y compris la caisse claire, se retrouvait aussi traité... ce qui donnait des mélodies absurdes avec les frappes de batterie. C'est marrant deux secondes, mais à la longue, ce n’était vraiment pas viable pour le show.

On a donc passé plusieurs jours à travailler spécifiquement sur ce problème : en studio, on prenait un micro et une caisse claire, et on passait des heures à frapper pour affiner le traitement. La scénographie — la fameuse "box" métallique — amplifiait encore ce phénomène. Il fallait absolument réussir à faire disparaître la caisse claire des micros chant.

Pour y parvenir, on a mis en place un traitement du signal en amont, avant même son entrée dans le vocodeur. Plutôt que de brancher le micro brut dans le vocodeur (comme ils en avaient l'habitude), nous avons créé une "préparation" spécifique du micro :

- Nettoyage

- Égalisation

- Compression

- Utilisation d'expandeurs et de PSE pour couper le micro lorsqu’ils ne chantent pas

- Automatisation de l’ouverture/fermeture via Ableton.

Tout ce travail permettait d'optimiser le signal, d’éviter que le son de la caisse claire viennent polluer le traitement vocodé et qu’on reste avec un résultat contrôlé.

DPA 5100 + 2015 Photo Julien Vouillon

L’expérience immersive

Julien : Faire de l’immersif en retour est une idée que j’avais en tête depuis longtemps, et Flo était vraiment le partenaire idéal pour aller plus loin. On était déjà allés très loin dans la création avec cette tournée — en termes de scénographie, de reproduction fidèle de l’album en live, d'outils mis à disposition des musiciens. Techniquement, tout était en place, même s'il restait toujours des ajustements possibles.

Et comme tout tournait bien, et qu'on avait du temps, on a voulu continuer à explorer.

Dans la logique de transposer l'album et le studio sur scène, je voulais aller encore plus loin : intégrer directement l’immersion sonore dans les ears en spatialisant des sources, pour que les artistes retrouvent la sensation du disque mais avec une sensation immersive.

J’ai donc décidé de reprendre des essais sur l'immersion binaurale que j’avais entamés quelques années auparavant. À l’époque, les premiers outils ne me convenaient pas du tout. Depuis longtemps, je travaille (à 95%) avec DIGICO et quand ils ont racheté le système immersif allemand Klang, ils m’ont envoyé un prototype pour test et intégration éventuelle dans mes projets.

J’ai essayé Klang mais à l’époque, ça ne me convenait pas du tout :

- Il y avait une latence supplémentaire de plus de 3 millisecondes, ce qui est inacceptable en in-ear, où on cherche à rester au plus proche de zéro.

- Le système utilisait un HRTF fixe, qui ne me semblait pas du tout réaliste : à chaque déplacement d’une source, je trouvais que le son se détimbrait, devenant inutilisable.

Cependant, j’avais tout de même repéré deux applications intéressantes avec Klang :

- Traiter les micros d’ambiance : au lieu de simplement les ajouter en stéréo, on pouvait les spatialiser dans un environnement binaural pour replacer naturellement l’artiste sur scène dans une "pièce virtuelle".

- Traiter les bus d’effets : passer les effets de batterie, de guitare, de voix dans Klang pour élargir subtilement l’espace sonore, créer un effet 3D et amplifier la sensation d'immersion, tout en respectant la sonorité des reverbs d’origine.

Même si ces deux idées étaient prometteuses, j’avais finalement mis ce projet de côté à l'époque, à cause des limitations techniques du système.

Peu après, j’ai travaillé sur un projet pour un groupe qui souhaitait un spectacle spatialisé, basé sur le système L-ISA de L-Acoustics. L'idée était d'intégrer la spatialisation pour le public, mais j’avais également commencé à réfléchir à l’idée d'incorporer cette spatialisation dans les in-ears, même si ce n'était pas une demande initiale du groupe. J'avais donc étudié la possibilité d'utiliser les processeurs L-ISA et leur fonction de réduction stéréo-binaurale, pour pouvoir recréer un environnement immersif sans avoir à déployer tout le système complet. Sur ce projet, les performances techniques étaient meilleures : la latence était plus faible, et le HRTF plus réaliste. Cependant, la solution restait extrêmement lourde : il aurait fallu un processeur L-ISA par musicien — un module de 4U, très coûteux —, ce qui n'était pas envisageable en pratique.

Finalement, ce projet n'a pas abouti, et je n'ai pas poursuivi cette piste.

Puis, j’ai gardé cette envie en tête et il y a environ un an et demi, je travaillais comme consultant technique pour un spectacle immersif événementiel. À cette occasion, j'ai rencontré Julien Panier de Novelty AURA, un opérateur spécialisé dans le SPAT.

Nous avons collaboré sur ce spectacle, et même si mon rôle était uniquement consultatif sur la façade, j'ai eu l'opportunité de lui parler de mon travail sur les in-ear. Il m'a alors présenté le SPAT et son fonctionnement.

Et là, j'ai enfin trouvé l'outil que je cherchais depuis des années :

- - Le son du moteur audio est excellent

- - Il est possible de personnaliser le HRTF

- - La latence est extrêmement faible, autour d'1 ms.

Photo Julien Vouillon

Pour la première fois, je disposais d’un outil réellement adapté pour développer un mix binaural immersif fiable et musical. Nous avons fait un grand pas avec la découverte du SPAT.

Dès la démonstration, j’ai vu que c'était extrêmement prometteur — même si je n'étais pas entièrement convaincu par l'utilisation d'un micro Ambéo de Sennheiser pour capter les ambiances.

Mais l'essentiel était là : l'outil était prêt, facile à mettre en œuvre, avec une latence parfaite et un HRTF personnalisable pour chaque utilisateur. Tous les problèmes techniques que j’avais rencontrés auparavant étaient enfin levés. Le vrai défi désormais, c’était de mettre en œuvre cette solution de manière aussi qualitative que ce que nous réalisions pour le mix musical.

Il ne s'agissait pas d’ajouter un simple "gadget" sonore : il fallait que la qualité des ambiances binaurales soit du même niveau que celle du son principal.

Le déploiement sur AIR

'À mes oreilles, il n’a aucun défaut intrinsèque : il reproduit fidèlement ce qu’il capte, exactement là où l’on se trouve. Il n’y a donc rien à corriger'

Le 5100 :

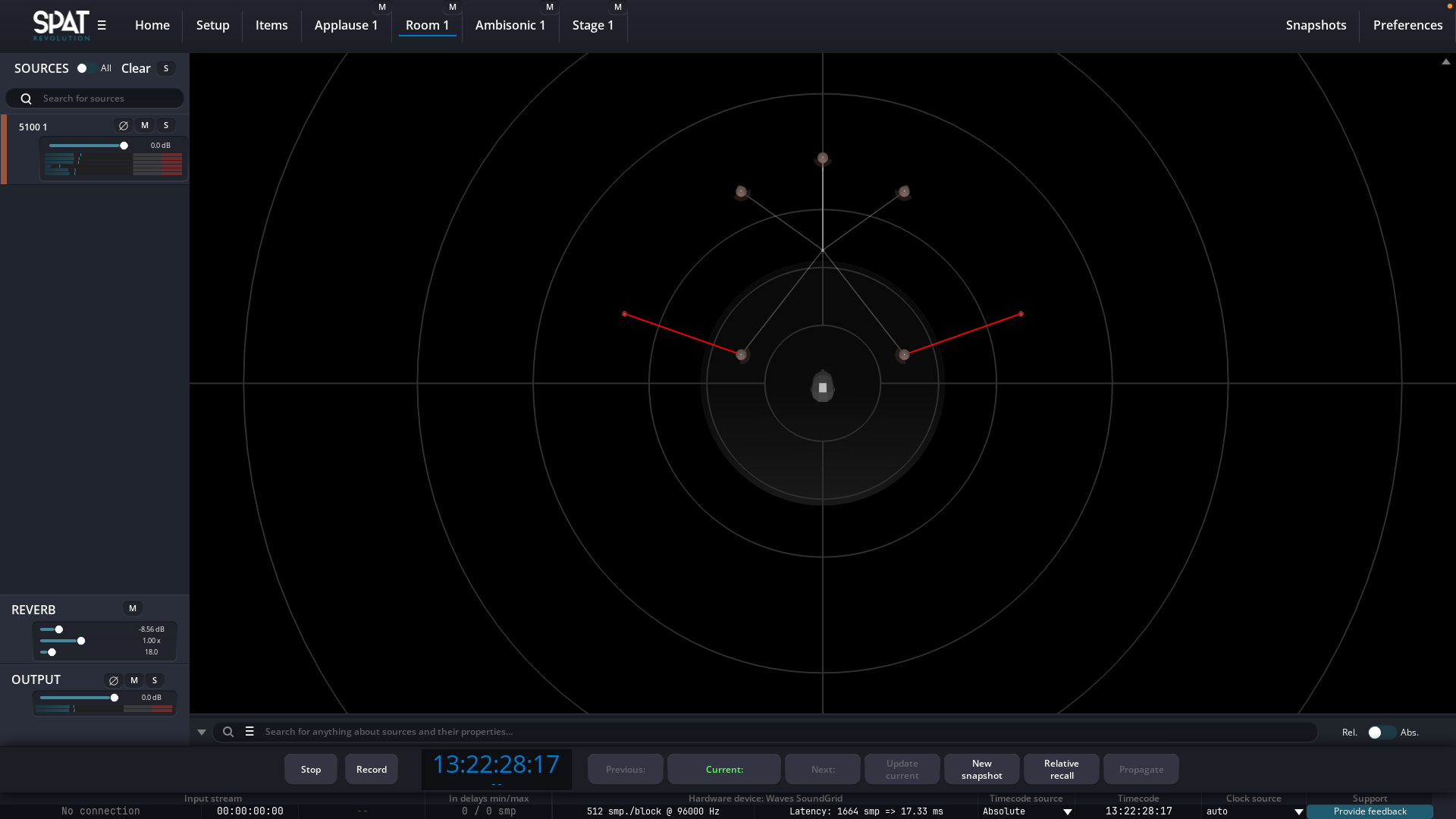

Julien : On a donc lancé tout le développement R&D autour de AIR pour ce projet d’immersif, et on a décidé de ne pas s'arrêter là. J'en ai parlé à Flo : je voulais continuer, intégrer le SPAT pour les ambiances, faire des essais sérieux. J’avais déjà testé avec un micro Ambéo, mais ce n’était pas assez qualitatif pour ce que je visais. Je savais que le SPAT pouvait délivrer le rendu que je voulais, j’adorais son moteur audio, mais il fallait trouver le bon micro.

C’est là que Florentin m’a parlé du DPA 5100, que je ne connaissais pas encore. Il avait déjà bossé un peu avec ce micro, notamment pour capter des sons de salle, et il avait été conquis.

Florentin : Déjà grand fan du DPA 4060 que j’utilisais partout (même sur des batteries), j’ai tout de suite pensé que le 5100 serait idéal : discret, facile d’utilisation avec ses connecteurs Lemo, et bien moins encombrant qu’un decca tree.

Julien : Grâce à l’équipe DPA, j’ai pu en obtenir un dès le début de la tournée pour commencer les tests. J’ai alors commencé à essayer plein de placements différents : devant la scène, au-dessus, sur un pont, dans la salle… J’ai cherché jusqu’à trouver le bon compromis. Finalement, l'emplacement qui fonctionnait le mieux était juste devant la scène, sur un tout petit pied, à hauteur relativement basse. Et là, le résultat a été bluffant : on retrouvait vraiment la sensation de la salle.

Florentin : En tant que musicien à la base, avant d’être ingénieur du son, j'ai ressenti immédiatement ce que ça apportait. Avec des ears classiques, c’est génial, tout est super bien mixé... mais il manque toujours quelque chose : la 3D naturelle de la pièce, l’air, l’espace. Grâce au 5100 et au SPAT, on retrouvait cette dimension manquante. Cela rendait l'expérience beaucoup plus naturelle et vivante.

SPAT : Photo Julien Vouillon

Julien : Notre démarche, c'était d'amener le musicien à écouter son propre album live. La première fois que j'ai entendu ce que donnait le DPA 5100, c'était incroyable. Même avant de passer par le SPAT, j'ai simplement créé une tranche Surround sur la console DIGICO, sans spatialisation binaurale, sans traitement spécifique : juste en Surround, intégré au mix. Et c'était déjà bluffant. Le respect des timbres est tel qu’il offre une transparence totale. À mes oreilles, il n’a aucun défaut intrinsèque : il reproduit fidèlement ce qu’il capte, exactement là où l’on se trouve. Il n’y a donc rien à corriger à ce niveau.

Depuis un an, nous avons travaillé dessus, testé toute la gamme de micros DPA, essayé différents placements, et affiné progressivement notre mix. Cela nous a permis d'atteindre un résultat extrêmement précis. On va expliquer ensuite comment nous avons procédé pour arriver à ce niveau de réalisme.

Julien : Sur 80 dates, nous avons expérimenté tous les jours des ajustements différents. À force d'essais, nous avons rapidement vu les limites de certaines options. Ce qui ne fonctionne pas une fois ne fonctionne jamais. En revanche, ce qui fonctionne a fini par révéler un dénominateur commun : le choix des micros et leur placement ne dépendent pas tant de la salle, mais surtout du positionnement des enceintes de diffusion.

Nous avons aussi mis au point une méthode spécifique de création des bus, que nous expliquerons en détail, et qui a été déterminante. Grâce à tout cela, nous avons trouvé une approche qui fonctionne partout, quelle que soit la salle.

Ce qui est remarquable, c'est que tout le système fonctionne parfaitement... sauf dans un cas. Même si, dans les ears, on n'entend que partiellement le mix façade, celui-ci influence la perception et l’expérience. Si le mix FOH est cohérent avec le mix retour tout s’aligne naturellement. En revanche, dès qu’il y a des disparités importantes entre la façade et les retours, cela perturbe l’équilibre global.

Photo : Julien Vouillon

Les 2015 :

Julien : Un point d’attention important est de réduire au maximum le délai entre la façade et l’ambiance : si le système de façade présente un gros offset par son installation ou son calage, nous demandons à l’ajuster pour que la façade soit la plus proche possible du temps zéro. Sinon, le delay est trop important, le musicien le ressent immédiatement et cela le gêne. L’objectif est que tout pousse ensemble, un peu comme à l’époque des wedges et des amplis guitare : les HP devaient envoyer le son en même temps pour que la sensation reste naturelle, enveloppante. Nous avons donc cherché une solution. Nous avons ajouté un couple de DPA 2015. Ces micros, orientés vers la scène et installés en ORTF classique, venaient compléter l’image sonore. Ainsi, pour le musicien, l’expérience devenait encore plus réaliste : il retrouvait son mix plongé dans l’ambiance de la salle, tout en percevant derrière lui la présence naturelle de la batterie et de la scène.

Les 2017 et les 2012 :

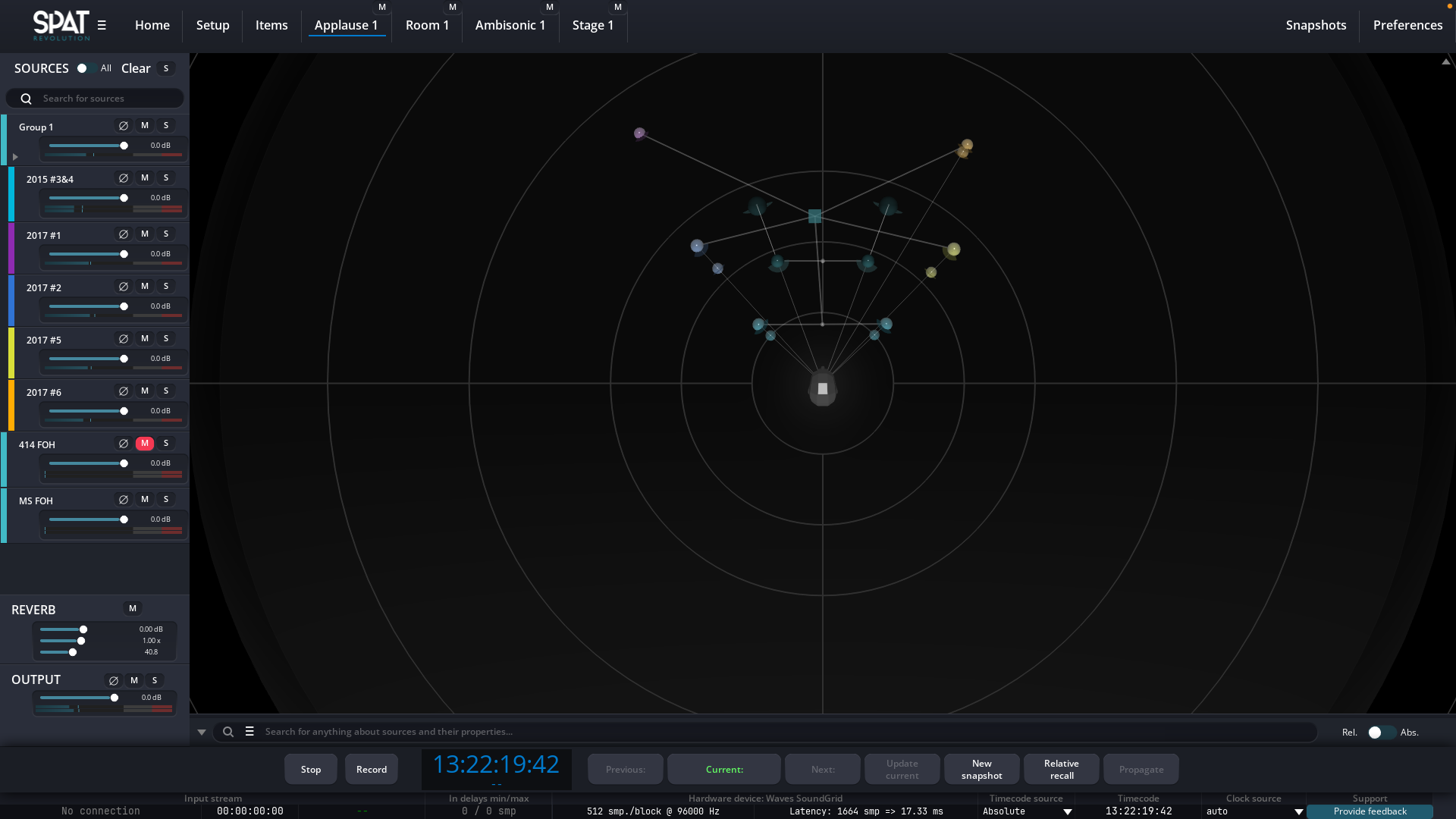

Florentin : Une fois que nous avons installé le 5100 + les 2015, nous avons constaté qu’ils étaient parfait pour reproduire ce que nous appelons « la pièce », c’est-à-dire l’endroit dans lequel on joue.

En revanche, il nous manquait encore le côté "applaudissements", qui était un peu sous-dimensionné.

Habituellement, sur un mix classique d’ambiances live, on capte les applaudissements, on les laisse plus ou moins ouverts pendant le concert en fonction de l'acoustique, et entre les morceaux, on les pousse un peu pour renforcer l’ambiance de la salle. C'est ainsi que procède la plupart des ingénieurs du son. Avec le 5100 intégré dans un environnement binaural, nous avons découvert que la reproduction était si fidèle qu’il n'y avait aucune dégradation des timbres, même en montant plus fort que ce que nous avions l’habitude de faire.

Il y avait une vraie corrélation avec la façade, et on pouvait laisser le 5100 ouvert sans problème. Cependant, il nous manquait toujours un peu cette sensation d’applaudissements. Nous avons donc ajouté un couple XY de DPA 2012 placé au centre, en complément des DPA 2017 disposés sur scène (deux à jardin et 2 à cour, deux légèrement recentrés). Grâce à cette combinaison, l’image sonore est beaucoup plus précise et naturelle.

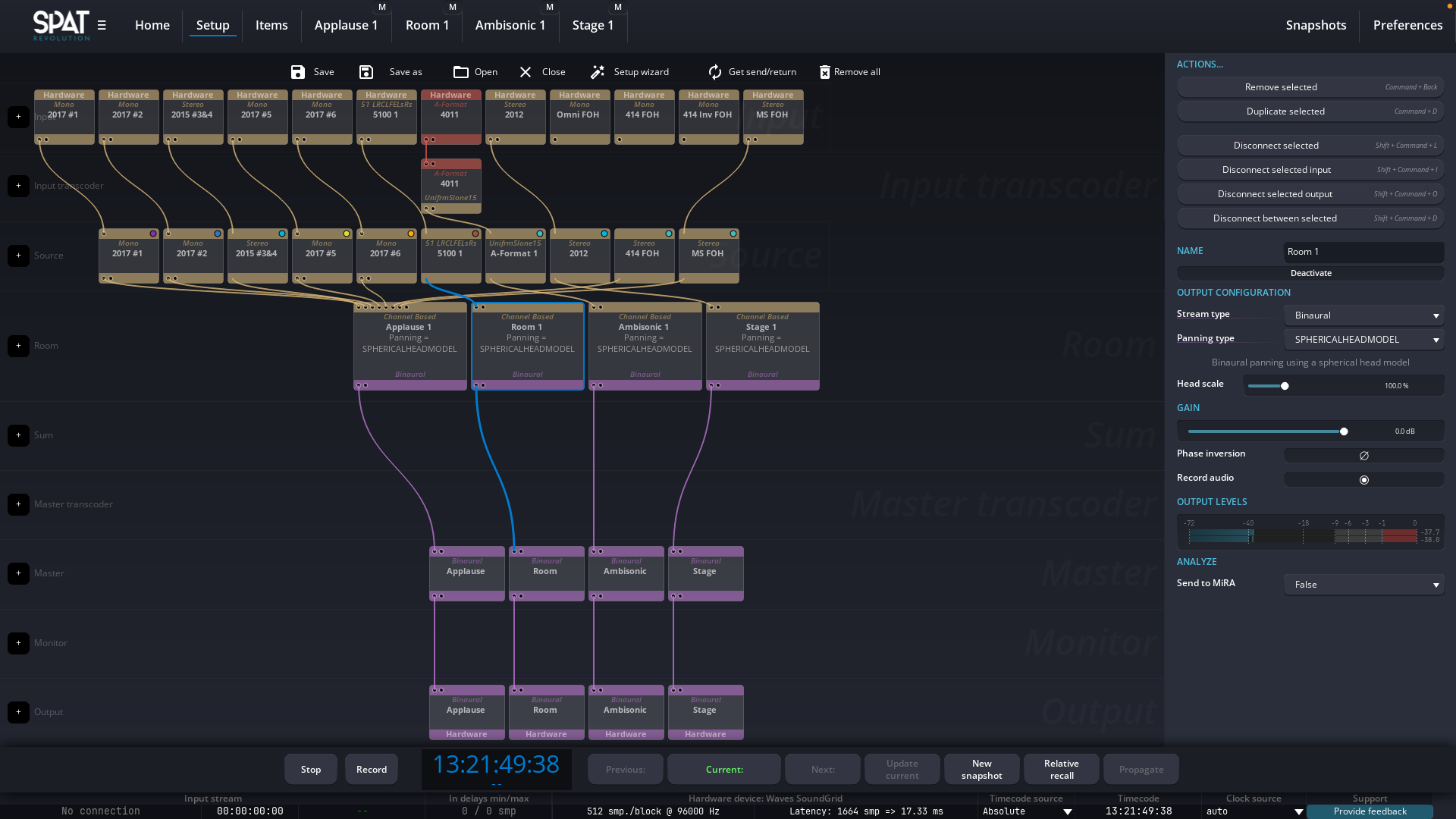

La gestion des bus :

Julien : Au départ, nous avions commencé nos tests sans encore avoir de contact avec SPAT. C’est Émile, notre « savant fou », qui nous a soufflé que SPAT partageait son moteur audio avec Panoramix, un logiciel développé par l'IRCAM. Nous avons donc commencé nos expérimentations avec Panoramix. Le rendu sonore était déjà très bon, mais son utilisation restait rudimentaire : il fallait mixer toutes les ambiances directement à la souris, ce qui était extrêmement contraignant.

Pour contourner cette lourdeur, j'ai demandé à Florentin et Émile de concevoir un "sidecar" : une petite console additionnelle permettant de piloter Panoramix en MIDI. Ils ont réussi à créer un pont qui permettait une manipulation beaucoup plus fluide et naturelle. Finalement, nous nous sommes rapprochés de l'équipe de SPAT pour leur présenter notre projet. Hugo Larin, le manager en charge du développement de SPAT s’est montré immédiatement enthousiaste. À l’origine, SPAT est conçu pour créer des spectacles immersifs multicanal en salle. Mais nous avons détourné son usage pour produire une réduction binaurale de haute qualité destinée à l’écoute au casque, sans passer par un système immersif complet.

Ce détournement a ouvert pour SPAT une nouvelle possibilité d’utilisation, en doublant les débouchés de leur logiciel. Avec SPAT, nous avons pu :

- Créer plusieurs rooms différentes (au lieu d’une seule)

- Générer plusieurs réductions binaurales indépendantes, chacune ramenée ensuite dans la console.

Nous avons ainsi mis en place trois réductions binaurales distinctes : une pour la captation principale avec le DPA 5100 (la room principale), une pour la scène avec un couple de DPA 2015, et une pour les applaudissements avec 4 x DPA 2017 et un couple XY en 2012.

Le processus est simple : tous les micros sont d’abord traités dans la console DIGICO (égalisation et compression), puis envoyés via un flux MADI vers SPAT, où chaque source est placée dans une pièce virtuelle spécifique.

À la sortie, chaque pièce génère un bus stéréo-binaural qui revient ensuite dans la console pour être intégré au mix général. Pour rendre l'ensemble naturel et cohérent, nous avons appliqué quelques traitements complémentaires : une compression légère sur la room principale pour limiter l’envahissement spatial, et une compression plus forte sur la room stage pour accentuer la sensation d’arrière-scène, en travaillant comme en compression parallèle.

Notre dispositif microphonique repose sur :

- Un DPA 5100 pour la pièce principale

- Un couple de DPA 2015 pour la scène

- Quatre DPA 2017 pour les applaudissements

- Un couple XY de DPA 2012 pour les applaudissements (au centre)

Tous ces bus — pièce principale, scène et applaudissements — reviennent ensuite dans la console DIGICO et sont intégrés de manière musicale au mix général.

SPAT | Photo Julien Vouillon

Florentin : Comme vient de le dire Julien, nous nous sommes dit qu'on adorait aussi mixer la musique, et qu’il serait intéressant de trouver une manière de rendre le tout vivant avec un minimum de mouvements de faders. L’idée était donc d’avoir un mix très naturel, qui respire sans intervention permanente.

Avec le bus dédié aux applaudissements, nous avons réussi à conserver une approche classique — comme cela se faisait historiquement — mais avec une qualité sonore bien supérieure, grâce aux DPA 2012, 2015 et 2017.

SPAT | Photo Julien Vouillon

L’arrivée du MKH en Live

Julien : Pour la petite histoire, au début des In-Ears-Monitor, personne n’avait vraiment le budget pour mettre des micros très qualitatifs pour capter les ambiances. À cette époque, j’étais “endorsé” par Sennheiser, et ils venaient de sortir la gamme MKH.

Au bout d’un an, cette gamme n’avait pas rencontré le succès escompté : ils avaient conçu ces micros pour le marché du classique, mais la plupart des ingénieurs déjà équipés en Schoeps ne voulaient pas investir dans de nouveaux micros. Résultat, ils ne savaient plus quoi faire de cette série, pourtant d'une qualité exceptionnelle. À ce moment-là, je tournais avec Jean-Michel Jarre. Grâce à notre partenariat, j’avais accès à toute cette gamme, qui était pourtant destinée à un usage haut de gamme et relativement coûteux.

J'ai ainsi commencé à utiliser les MKH pour des prises d’ambiance, notamment pour les ears monitors et pour capter les applaudissements — une pratique qui, à l'époque, n'était pas encore répandue. C’était déjà un saut qualitatif impressionnant, avec un respect des timbres remarquable. Aujourd'hui, ironiquement, la prise d’ambiance est devenue l’un des principaux marchés de cette gamme.

J'avais l'habitude d'utiliser les micros de la gamme MKH de Sennheiser. Mais après que Florentin m’a fait découvrir les DPA 2012, 2015 et 2017, j’ai été bluffé dès la première écoute, notamment sur la prise d’ambiance et d’applaudissements. Avec les DPA, il n'y avait plus aucun artefact : les transitoires étaient parfaites, la profondeur était là, tout y était. J'ai donc remplacé toutes mes anciennes habitudes avec la gamme MKH de Sennheiser par la gamme DPA.

La gestion du bus applaudissement

Florentin : La gestion de ce bus s’est faite en trois étapes. Dans un premier temps, nous avons traité l’évidence : il était impossible de laisser le bus d’applaudissements ouvert en permanence, au risque de détériorer le mix final. Nous avons donc adopté une approche classique : je faisais apparaître ou disparaître les applaudissements en fonction des moments. Cette fois, cependant, le rendu était spatialisé grâce aux SPATs et aux DPA 2012 et 2017, ce qui offrait un résultat bien plus naturel et musical.

Julien : Dans un second temps, nous avons automatisé cette gestion à l’aide d’une compression en sidechain, déclenchée par la musique. Dès que celle-ci démarre, le bus d’applaudissements est compressé et s'efface naturellement ; lorsqu’elle s’arrête, le bus se rouvre en douceur. Nous avons passé du temps à peaufiner les réglages — attaque, release, taux de compression, choix du compresseur — jusqu’à obtenir un comportement parfaitement fluide. Aujourd’hui, le bus reste actif en permanence : il se compresse dès que les musiciens jouent et se relâche subtilement à la fin des morceaux. Cela permet de conserver un fond vivant — cris, réactions spontanées — qui apporte beaucoup de vie. Grâce à la spatialisation, les artistes perçoivent précisément d’où viennent les sons du public, et même sur les fins de morceaux, l'action du compresseur est quasiment imperceptible.

Dans un troisième temps, nous avons amélioré le déclenchement de la compression. Au départ, nous ajustions manuellement le seuil du compresseur selon les titres : certains morceaux étant très dynamiques, d’autres beaucoup plus doux. Le compresseur fonctionnait bien avec les titres puissants, mais sur des passages plus subtils — fréquents chez AIR —, le niveau sonore n’était pas suffisant pour activer la compression. L’ambiance de salle apparaissait alors de manière intempestive, avant que le public n’ait réellement réagi, ce qui venait délaver le mix principal.

Pour corriger cela, nous avons eu l’idée d’ajouter du bruit rose dans le bus de sidechain qui pilote la compression. Aujourd’hui, je ne touche plus au seuil du compresseur ; je module simplement l’envoi du bruit rose dans le sidechain. Sur les morceaux forts, il est inutile ; sur les titres plus calmes ou en introduction, il permet de maintenir la compression active jusqu’au bon moment. C’est une solution simple, musicale, et parfaitement maîtrisée. Concrètement, selon le niveau sonore du morceau :

- Sur un titre fort, je n'ai pas besoin d'ajouter de bruit rose : la compression s'active naturellement.

- Sur un morceau doux ou en début de titre, j'ajoute du bruit rose pour maintenir la compression active tant que je le souhaite, évitant ainsi que l'ambiance n'apparaisse prématurément.

Photo Julien Vouillon

Cette méthode est plus musicale je trouve. Si un morceau commence doucement, je peux envoyer du bruit rose pour maintenir la compression, puis le retirer progressivement avant la fin pour libérer naturellement les réactions du public au bon moment. Cela permet de mixer en anticipant la dynamique du morceau.

Concernant le choix du bruit rose :

- Le bruit rose est plus naturel qu'un simple tone : il est vivant, légèrement fluctuant, ce qui le rend plus musical.

- Il excite le compresseur de façon plus fluide et naturelle, car il est réparti de manière homogène sur toutes les fréquences, à l’image d'un bruit de fond réel.

Ce petit ajustement technique a permis de rendre le tout extrêmement fluide et naturel, en gardant un contrôle total sur l’apparition et la disparition de l’ambiance publique dans les ears.

Merci ! Merci à vous pour votre accompagnement et pour fabriquer des micros de cette qualité ! Bravo !

Un Immense merci à toute l’équipe de AIR pour leur confiance. Et un non-moins immense merci à MPM audiolight pour l’aide quotidienne dans ce projet.

Pour suivre Julien et Florentin sur les réseaux sociaux c'est ici : Instagram Julien | Instagram Florentin